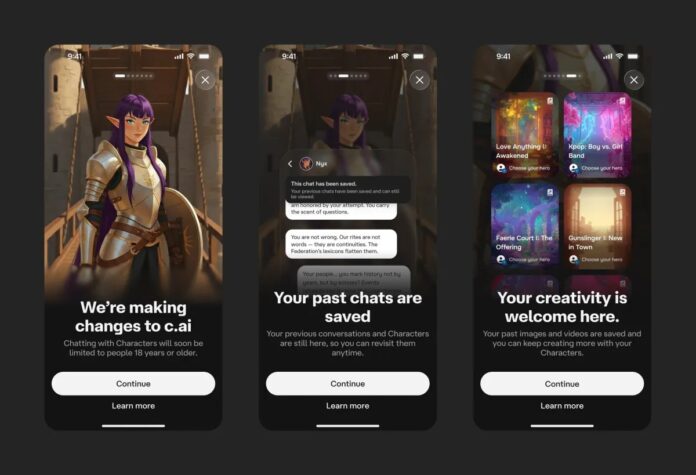

A Character AI está lançando “Stories”, um formato de ficção interativo, em resposta aos crescentes riscos à saúde mental associados ao seu serviço de chatbot aberto. A empresa bloqueou completamente o acesso aos seus chatbots para usuários menores de 18 anos, uma mudança que segue ações judiciais que alegam uma conexão entre interações de IA e suicídios.

A ascensão dos chatbots de IA e a reação negativa

No mês passado, a Character AI restringiu gradualmente o acesso de menores. Na terça-feira, usuários menores de idade não podiam mais participar de bate-papos livres com personagens de IA. Essa mudança ocorre em meio a um escrutínio crescente de companheiros de IA 24 horas por dia, 7 dias por semana, que iniciam conversas, potencialmente levando à dependência e danos psicológicos.

Vários processos judiciais foram movidos contra empresas como OpenAI e Character AI, destacando os perigos do acesso irrestrito à IA. A pressão legal e a preocupação pública forçaram uma mudança para um formato mais estruturado.

O que são “histórias” e por que agora?

“Histórias” oferecem uma experiência narrativa guiada, permitindo aos usuários interagir com personagens dentro de cenários pré-definidos. Isto difere bastante dos chatbots, que permitem interações abertas e não solicitadas.

A IA de personagens enquadrou isso como uma abordagem que prioriza a segurança: “As histórias oferecem uma maneira guiada de criar e explorar ficção, em vez de um bate-papo aberto”. O momento também se alinha com a crescente popularidade da ficção interativa, tornando-a uma alternativa viável.

Reações do usuário e pressão regulatória

A resposta dos adolescentes é mista. Alguns reconhecem a proibição como um passo necessário para conter o vício. Um usuário do subreddit Character AI escreveu: “Estou tão bravo com a proibição, mas também muito feliz porque agora posso fazer outras coisas e meu vício pode finalmente acabar”. Outros expressaram decepção, embora ainda reconhecessem a validade da decisão.

A mudança ocorre juntamente com o aumento da regulamentação legal dos acompanhantes de IA. A Califórnia tornou-se recentemente o primeiro estado a regulamentar essas ferramentas, e um projeto de lei nacional está em consideração que proibiria totalmente os acompanhantes de IA para menores.

Um pivô necessário?

O pivô da IA de personagens para “Histórias” é uma resposta aos danos tangíveis e à crescente regulamentação. Embora o novo formato possa não satisfazer totalmente os usuários acostumados ao acesso irrestrito ao chatbot, ele representa um ambiente mais controlado e menos arriscado psicologicamente. A decisão sublinha a necessidade de uma maior supervisão no campo em rápida evolução das interações de IA.