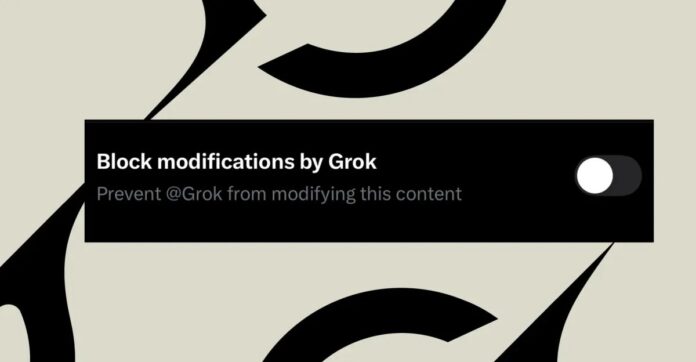

Les utilisateurs de X (anciennement Twitter) peuvent désormais empêcher l’IA de la plateforme, Grok, de modifier automatiquement leurs images téléchargées. Une nouvelle option de case à cocher permet aux utilisateurs de désactiver ces modifications, mais les experts affirment que cela ne résout qu’une petite partie d’un problème plus vaste.

La fonctionnalité a été ajoutée discrètement, sans annonce officielle de X. Actuellement, si une image est téléchargée, Grok peut automatiquement appliquer des modifications telles que des ajustements de netteté ou de contraste. La nouvelle case à cocher empêche que cela se produise.

Cependant, le problème ne concerne pas uniquement les modifications indésirables ; c’est le manque de transparence. Les utilisateurs se sont plaints du fait que les modifications se produisent sans notification claire, ce qui rend difficile l’annulation des modifications ou la connaissance de ce qui a été modifié. La case à cocher ne résout pas ce problème principal.

De plus, les modifications de l’IA elles-mêmes ont été incohérentes, améliorant parfois les images et d’autres fois introduisant des artefacts ou des distorsions indésirables.

“C’est une solution de fortune”, déclare Kara Sterling, analyste des médias numériques. “Les utilisateurs doivent avoir un contrôle total sur la question de savoir si l’IA touche leurs images, et ils doivent savoir exactement quand et comment les modifications sont appliquées.”

La mise à jour semble être une réaction à la frustration croissante des utilisateurs, mais elle ne parvient pas à offrir un véritable contrôle. Le plus gros problème demeure : le traitement automatique des images de X est opaque et la nouvelle case à cocher constitue une solution de contournement limitée.

Pour l’instant, les utilisateurs qui souhaitent éviter l’intervention de l’IA doivent désactiver manuellement la fonctionnalité à chaque téléchargement. C’est fastidieux et n’empêche pas les modifications de se produire en premier lieu si la case à cocher est manquée.

La situation met en évidence une tendance plus large dans les médias sociaux : les plateformes proposent des fonctionnalités d’IA sans répondre pleinement aux préoccupations des utilisateurs en matière de confidentialité, de contrôle et de transparence.

En conclusion, même si la nouvelle case à cocher constitue un pas dans la bonne direction, elle est loin d’être une solution complète. X doit donner la priorité à la clarté de l’utilisateur et au contrôle de son traitement automatisé des images s’il veut éviter de nouvelles réactions négatives.