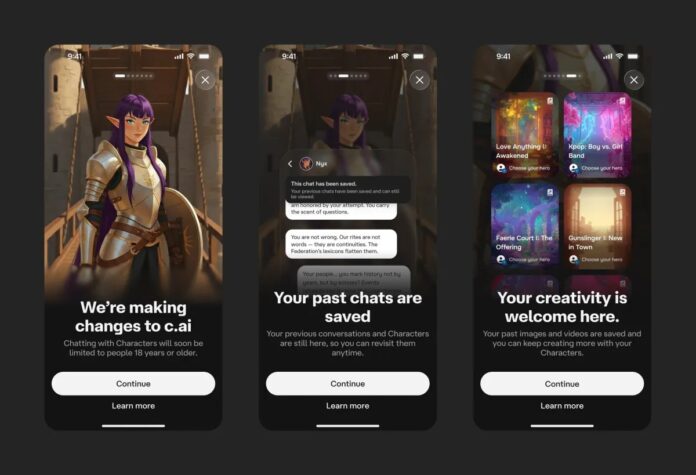

Character AI déploie « Stories », un format de fiction interactif, en réponse aux risques croissants pour la santé mentale liés à son service de chatbot ouvert. La société a complètement bloqué l’accès à ses chatbots pour les utilisateurs de moins de 18 ans, un changement qui fait suite à des poursuites alléguant un lien entre les interactions de l’IA et les suicides.

L’essor des chatbots IA et les réactions négatives

Depuis un mois, Character AI a progressivement restreint l’accès aux mineurs. Mardi, les utilisateurs mineurs ne pouvaient plus participer à des discussions libres avec des personnages IA. Cette décision intervient dans un contexte de surveillance croissante des compagnons IA 24h/24 et 7j/7 qui engagent des conversations, conduisant potentiellement à une dépendance et à des dommages psychologiques.

Plusieurs poursuites ont été intentées contre des sociétés comme OpenAI et Character AI, soulignant les dangers d’un accès illimité à l’IA. La pression juridique et l’inquiétude du public ont forcé un changement vers un format plus structuré.

Que sont les « histoires » et pourquoi maintenant ?

Les « histoires » offrent une expérience narrative guidée, permettant aux utilisateurs d’interagir avec des personnages dans des scénarios prédéfinis. Cela diffère fortement des chatbots, qui permettent des interactions ouvertes et non sollicitées.

Character AI a présenté cela comme une approche axée sur la sécurité : “Les histoires offrent une manière guidée de créer et d’explorer de la fiction, au lieu d’une discussion ouverte.” Le timing correspond également à la popularité croissante de la fiction interactive, ce qui en fait une alternative viable.

Réactions des utilisateurs et pression réglementaire

La réponse des adolescents est mitigée. Certains reconnaissent que l’interdiction est une étape nécessaire pour lutter contre la dépendance. Un utilisateur du subreddit Character AI a écrit : « Je suis tellement en colère contre l’interdiction mais aussi tellement heureux parce que maintenant je peux faire autre chose et ma dépendance pourrait enfin être terminée. » D’autres ont exprimé leur déception, tout en reconnaissant la validité de la décision.

Ce changement s’accompagne d’une réglementation juridique croissante des compagnons d’IA. La Californie est récemment devenue le premier État à réglementer ces outils, et un projet de loi national est à l’étude qui interdirait complètement les compagnons d’IA aux mineurs.

Un pivot nécessaire ?

Le pivot de Character AI vers les « histoires » est une réponse à des dommages tangibles et à une réglementation croissante. Même si le nouveau format ne satisfait pas pleinement les utilisateurs habitués à un accès illimité aux chatbots, il représente un environnement plus contrôlé et moins risqué psychologiquement. La décision souligne la nécessité d’une plus grande surveillance dans le domaine en évolution rapide des interactions avec l’IA.