Google ha lanzado al público su detector de contenidos de IA, SynthID, con la esperanza de abordar el creciente problema de los medios sintéticos. La herramienta identifica imágenes creadas por los modelos de IA de Google mediante marcas de agua invisibles, pero su utilidad está gravemente limitada por su incapacidad para detectar contenido generado por otras plataformas de IA.

La creciente marea de contenido generado por IA

La proliferación de herramientas de imágenes y vídeos de IA ha provocado un aumento de los medios sintéticos y deepfakes en línea. Herramientas como Sora de OpenAI y Nano Banana Pro de Google permiten a cualquiera crear contenido falso realista con facilidad, lo que hace cada vez más difícil distinguir entre material auténtico y artificial. Esta escalada plantea un desafío importante para la confianza en línea y la integridad de la información.

SynthID: una solución parcial

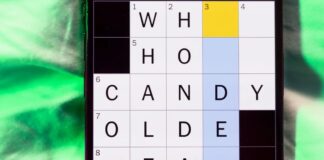

Google introdujo SynthID en 2023, incorporando marcas de agua invisibles en todo el contenido generado por IA desde sus plataformas. El lanzamiento público de SynthID Detector permite a los usuarios cargar imágenes en Gemini y comprobar si fueron creadas con Google AI. Sin embargo, la herramienta sólo reconoce imágenes que se originan en los modelos de Google, dejando el contenido de otras fuentes sin detectar.

La herramienta es esencialmente un jardín amurallado. Confirma la autoría de la IA de Google, pero no proporciona información sobre si una imagen fue generada por otro programa.

Esta limitación es crítica: con docenas de modelos de IA disponibles, SynthID no puede proporcionar una evaluación integral del contenido sintético. Google planea expandir el detector a video y audio, pero la limitación fundamental persiste.

Por qué esto es importante

La incapacidad de detectar de manera confiable el contenido generado por IA tiene consecuencias de gran alcance. Las campañas de desinformación, los deepfakes maliciosos y la erosión de la confianza en los medios digitales se ven exacerbados por la falta de herramientas de detección efectivas. Si bien SynthID es un paso en la dirección correcta, su alcance limitado resalta el desafío más amplio de verificar la autenticidad en un mundo cada vez más sintético.

Para mitigar los riesgos, los usuarios deben etiquetar el contenido generado por IA de manera responsable y acercarse a los medios en línea con escepticismo. Los modelos de IA generativa están mejorando rápidamente, superando las capacidades de detección actuales, lo que hace que la vigilancia sea esencial.