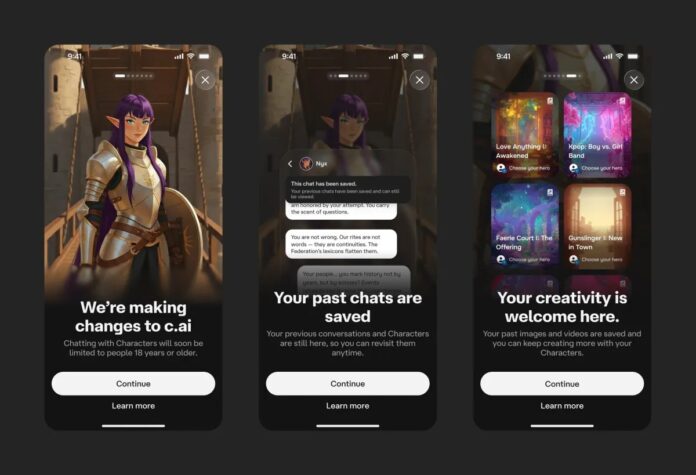

Character AI führt „Stories“ ein, ein interaktives Fiktionsformat, als Reaktion auf die wachsenden Risiken für die psychische Gesundheit im Zusammenhang mit seinem offenen Chatbot-Dienst. Das Unternehmen hat den Zugriff auf seine Chatbots für Benutzer unter 18 Jahren vollständig gesperrt, eine Änderung, die auf Klagen folgt, in denen ein Zusammenhang zwischen KI-Interaktionen und Selbstmorden behauptet wird.

Der Aufstieg von KI-Chatbots und die Gegenreaktion

Seit einem Monat hat Character AI den Zugang für Minderjährige schrittweise eingeschränkt. Ab Dienstag konnten minderjährige Benutzer keine freien Chats mehr mit KI-Charakteren führen. Dieser Schritt erfolgt vor dem Hintergrund einer zunehmenden Überwachung von KI-Begleitern, die rund um die Uhr Gespräche initiieren, was möglicherweise zu Abhängigkeit und psychischen Schäden führt.

Gegen Unternehmen wie OpenAI und Character AI wurden mehrere Klagen eingereicht, die die Gefahren eines uneingeschränkten KI-Zugriffs verdeutlichen. Der rechtliche Druck und die öffentliche Besorgnis erzwangen eine Umstellung auf ein strukturierteres Format.

Was sind „Geschichten“ und warum jetzt?

„Stories“ bieten ein geführtes Erzählerlebnis, das es Benutzern ermöglicht, mit Charakteren in vordefinierten Szenarien zu interagieren. Dies unterscheidet sich deutlich von den Chatbots, die unbefristete, unaufgeforderte Interaktionen ermöglichen.

Die Charakter-KI formulierte dies als einen sicherheitsorientierten Ansatz: „Geschichten bieten eine geführte Möglichkeit, Fiktion zu erstellen und zu erkunden, anstelle von offenen Chats.“ Der Zeitpunkt passt auch zur steigenden Beliebtheit interaktiver Fiktion und macht sie zu einer praktikablen Alternative.

Benutzerreaktionen und regulatorischer Druck

Die Reaktion der Jugendlichen ist gemischt. Einige betrachten das Verbot als einen notwendigen Schritt zur Eindämmung der Sucht. Ein Benutzer im Subreddit „Character AI“ schrieb: „Ich bin so wütend über das Verbot, aber auch so glücklich, weil ich jetzt andere Dinge tun kann und meine Sucht vielleicht endlich vorbei ist.“ Andere äußerten ihre Enttäuschung, erkannten aber dennoch die Gültigkeit der Entscheidung an.

Die Änderung erfolgt parallel zu einer zunehmenden gesetzlichen Regulierung von KI-Begleitern. Kalifornien hat kürzlich als erster Staat diese Tools reguliert, und es wird ein nationaler Gesetzentwurf geprüft, der KI-Begleiter für Minderjährige gänzlich verbieten würde.

Ein notwendiger Dreh- und Angelpunkt?

Der Schwerpunkt der Charakter-KI auf „Stories“ ist eine Reaktion auf spürbaren Schaden und zunehmende Regulierung. Während das neue Format Benutzer, die an uneingeschränkten Chatbot-Zugriff gewöhnt sind, möglicherweise nicht vollständig zufriedenstellt, stellt es eine kontrolliertere und psychologisch weniger riskante Umgebung dar. Die Entscheidung unterstreicht die Notwendigkeit einer stärkeren Aufsicht im sich schnell entwickelnden Bereich der KI-Interaktionen.